Fechas y horarios:

Lunes 15 de Septiembre - 6:00 p.m. 8:00 p.m.

Lunes 22 de Septiembre - 6:00 p.m. - 9:00 p.m.

Miércoles 24 de Septiembre - 6:00 p.m. - 9:00 p.m.

Lugar: Actividad virtual

Aforo esperado: 20 participantes

Perfil de participantes: Artistas, practicantes creativos, músicxs, pensadorxs y curiosxs de la tecnología y ciudadanía en general.

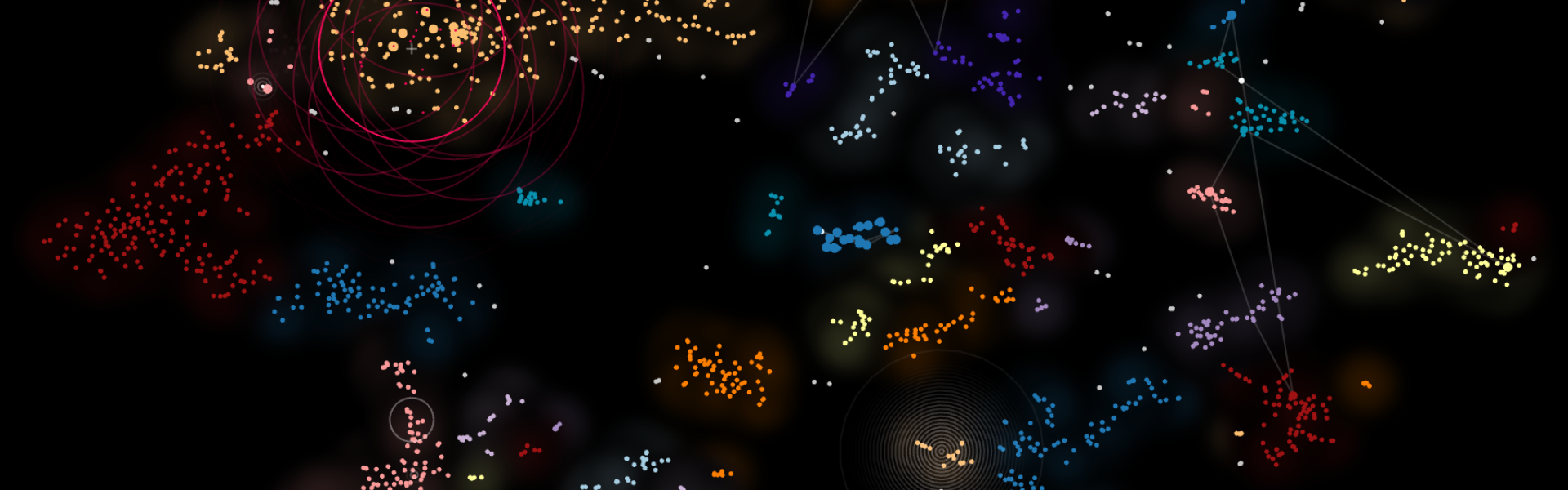

Fechas de inscripción: Del 15 de agosto al 5 de septiembre

Descripción: AudioStellar es un instrumento musical experimental de código abierto que utiliza inteligencia artificial para generar mapas sonoros a partir de grabaciones de audio. Se desarrolla desde 2017 en el marco de un proyecto de investigación de la UNTREF en Buenos Aires, se trata de un software pionero en el cruce de IA y sonido. La propuesta es de 3 encuentros, el primero es expositivo y combina una introducción al software, un recorrido por nuestras prácticas como colectivo artístico, los vectores conceptuales y poéticos que surgen desde las mismas en torno a la escucha, el paisaje sonoro y la relación humano/máquina, y por último, algunos tópicos introductorios sobre machine learning y audio. Los otros dos encuentros son completamente prácticos: crearemos mapas sonoros en AudioStellar con el material que cada participante traiga, les enseñaré a utilizar las funcionalidades básicas y discutiremos las características para la composición, diseño sonoro, performance e instalación que ofrece.

Tallerista:

Leandro Garber

Nace en Buenos Aires, es artista y científico de datos. Licenciado en Artes Electrónicas de la UNTREF y Magíster en Minería de Datos de la UBA. Lleva a cabo diversos cursos sobre inteligencia artificial aplicada al arte en universidades y otras instituciones. Ha lanzado una variedad de álbumes musicales y realiza instalaciones donde indaga acerca de tecnología e individuo, la intimidad desde la subjetividad maquínica.

Desde 2018 dirige un grupo de investigación enfocado en algoritmos generativos y exploratorios de inteligencia artificial donde nace AudioStellar, un instrumento musical experimental potenciado por IA. El proyecto integra performers, sensores de movimiento e interfaces que dan lugar a diversas performances en vivo que combinan música, visuales, y danza. El proyecto se ha presentado en forma de instalaciones, performances, seminarios y workshops en espacios artísticos y académicos nacionales e internacionales.